Google I/O: así se llama el evento anual en el que la compañía de la “gran G” presenta al mundo sus principales novedades en Android, inteligencia artificial, su buscador y otros productos y servicios.

La edición de este año pasará a la historia por la serie de nuevas herramientas y funciones que dan la sensación de que Google no está dispuesta a ceder terreno frente a la competencia. A pesar del avance de nuevos actores, los años de investigación y desarrollo siguen rindiendo frutos con innovaciones que la diferencian —y alejan— del resto.

En su discurso de apertura, el CEO de Alphabet y Google, Sundar Pichai, destacó lo que sería el rumbo de la presentación: “El mundo está respondiendo, adoptando la IA más rápido que nunca”. Ante esto, en la firma no son ajenos a esa ya nueva realidad, por lo que ofrecieron alternativas más potentes a las actuales junto con novedades que sorprendieron.

“Estamos en una nueva fase del cambio de la plataforma de la IA. Donde décadas de investigación ahora se están volviendo realidad para personas, empresas y comunidades en todo el mundo”, apuntó Pichai.

En prácticamente dos horas de presentación, Google dio a conocer detalles de Gemini 2.5, su inteligencia artificial más avanzada hasta la fecha, con una capacidad de razonamiento mejorada que le permite abordar tareas complejas, como matemáticas avanzadas y programación. Pero eso fue solo el comienzo.

También se presentó una nueva forma de comprender el entorno gracias a Gemini Live, que, mediante la cámara, es capaz de interpretar lo que ve, dar contexto y responder en tiempo real a las consultas del usuario. A esto se suman nuevos modelos de generación de imagen y video que ahora pueden incluir audio, unas nuevas gafas inteligentes potenciadas por IA y, por si fuera poco, un nuevo buscador de Google que promete cambiar el paradigma de quienes lo usan a diario.

A continuación, lo más destacado y sorprendente del Google I/O 2025:

Traducción de voz en tiempo real

Google está apostando a eliminar las barreras del idioma gracias a la inteligencia artificial. En su reciente actualización a Meet –su servicio de videollamadas–, está sumando la opción de traducción simultánea de voz. Esto permitirá que personas que no hablan el mismo idioma puedan entenderse en tiempo real, gracias a Gemini, el asistente con IA que actuará como intérprete..

Por ahora este servicio está solo disponible entre inglés y español, pero se espera que en las próximas semanas haya soporte para italiano, alemán y portugués. Eso sí, esta característica –en fase beta– la pueden probar únicamente los suscriptores de los nuevos plan de inteligencia artificial de Google, AI Pro y AI Ultra.

Probador de ropa virtual

¿Me quedará bien esa ropa que estoy viendo por internet? Esa pregunta intenta responder Google con su nueva función de Try it on, o pruébalo en español. Con ello, cuando se realicen búsquedas de ropa o vestuario mediante el mismo buscador, se podrán interactuar con los diferentes modelos de diferentes marcas y ver cómo luciría en uno.

Para utilizar esta función, se debe subir una foto de cuerpo completo. La inteligencia artificial de Google es capaz de interpretar el volumen corporal, los matices de la ropa y los materiales de cada prenda, para ajustarlos y generar una visualización lo más realista posible del conjunto sobre el cuerpo del usuario.

Un asistente que observa, comprende y actúa

En 2024 Google presentó el Proyecto Astra, un ambicioso modelo de inteligencia artificial que utiliza la cámara del celular para asistirte en tiempo real con lo que observa. Su objetivo no es solo responder a lo que ve, sino también anticiparse y ser proactivo con el usuario.

Justamente, eso último es lo más novedoso. Si hasta ahora se sabía que era capaz de comprender el entorno y mantener un diálogo fluido con la persona, ahora puede recordar interacciones pasadas e incluso corregirte sin que se lo pidas explícitamente.

Nace el “AI Filmmaker”

Ya hace bastante sabemos que existen diferentes modelos de inteligencia artificial que pueden crear imágenes, e incluso videos. Pues Google lo lleva al siguiente nivel con un estudio virtual para cineastas, quienes podrán crear escenas con audio incluido.

Se trata de Flow, que mezcla las tecnologías VEO e Imagen de Google; la primera encargada de crear videos, y la segunda, de imágenes. Todas estas recibieron actualizaciones que potencian su fidelidad de creación, las que combinadas crean una única herramienta de creación cinematográfica IA.

“Con Flow, la nueva generación de narradores puede crear clips, escenas e historias cinematográficas de forma fluida y con coherencia entre personajes y objetos”, dice Google.

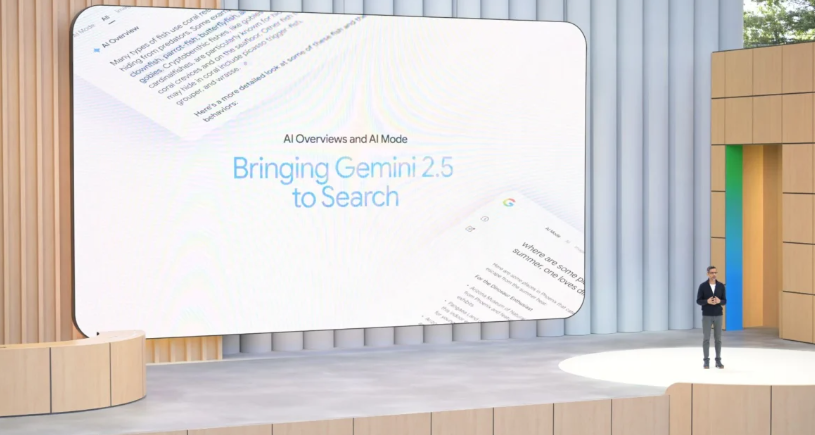

La IA reinventa el buscador de Google

Era cosa de tiempo para que la ola de la inteligencia artificial se extendiera más ampliamente al buscador de Google, y ahora es oficial. Esto ya que ahora nace una nueva forma de asistir a los requerimiento del usuario con AI Mode, o Modo IA en Google.

Si ya teníamos las pestañas Web, Imágenes, Noticias, etc; ahora tenemos el Modo IA que hará que las búsquedas se parezcan mucho a como es actualmente consultar en un chatbot, pero con imágenes y otros elementos que enriquecerán la experiencia.

En definitiva, será el modelo Gemini 2.5 el que estará disponible para todos los usuarios del buscador, inicialmente sólo en Estados Unidos. Ya actualmente existe un IA Overview al realizar búsquedas que dan respuesta rápida a consultas. Pues bien, esto es el paso siguiente donde también se suma el uso de cámara.

Las nuevas gafas inteligentes de Google

Google fue el pionero en su momento por apostar en lentes con capacidades tecnológicas. Lo hizo en 2012 cuando presentó el ya extinto Google Glass. A ya 13 años de aquello, la compañía presentó un nuevo modelo que toma fotos, graba, escucha, comprende y hasta traduce en tiempo real con información en el vidrio.

Este nuevo desarrollo lo realiza Google en colaboración con Xreal, y funciona sobre Android XR, una plataforma diseñada para dispositivos de realidad extendida como cascos y lentes.

En lo mostrado se pudo ver (video abajo) el potencial del equipo, aunque poco se dijo de algún lanzamiento que, de todas formas, debería ser pronto. Asimismo, se abrirá a que desarrolladores trabajen en aplicaciones para el mismo.

Algo que sorprende de todo lo presentado es la gran integración de la inteligencia artificial con el ecosistema de productos de Google, aprovechando el hardware ya disponible. Muchas de estas funciones no requieren dispositivos nuevos ni costosos: basta con un teléfono Android o incluso un iPhone para comenzar a usarlas.

Y mientras durante años la batalla tecnológica se libró en el terreno de los sistemas operativos, todo indica que la próxima gran disputa será otra: quién logre integrar de forma más adecuada, coherente y funcional la inteligencia artificial en la vida cotidiana de las personas. Y en eso Google lleva camino avanzado.

Fuente: The Clinic